LLM en 2026: qué son los modelos de lenguaje, cómo funcionan y cómo usarlos

Índice

- 1

- 1.1 Qué es un LLM (Large Language Model)

- 1.2 Los principales LLMs en 2026

- 1.3 Cómo elegir el LLM adecuado para tu caso

- 1.4 Cómo usar LLMs en automatizaciones con n8n

- 1.5 LLMs para empresas: aplicaciones prácticas

- 1.6 El futuro de los LLMs: tendencias 2026-2027

- 1.7 Aprende a usar LLMs con n8n en VA360 Academy

- 1.8 Preguntas frecuentes

Si has usado ChatGPT, le has pedido algo a Claude o has probado Gemini, ya has interactuado con un LLM (Large Language Model). Pero, ¿realmente entiendes qué es un modelo de lenguaje grande, cómo funciona por dentro y, lo más importante, cómo puedes aprovecharlo en tu negocio o tus proyectos? En 2026, entender los LLMs ya no es algo opcional: es una habilidad fundamental.

La velocidad a la que evoluciona este campo es vertiginosa. Cada pocos meses aparecen nuevos modelos más potentes, más baratos y más rápidos. Desde GPT-4o hasta Claude 4, pasando por Gemini 2.0 y los modelos open-source de Meta, el ecosistema es más rico y accesible que nunca.

En esta guía te voy a explicar todo lo que necesitas saber sobre los LLMs en 2026: qué son, cómo funcionan, cuáles son los principales, cómo elegir el adecuado y, sobre todo, cómo integrarlos en automatizaciones prácticas con herramientas como n8n. Vamos allá.

Qué es un LLM (Large Language Model)

Un LLM o Large Language Model (Modelo de Lenguaje Grande) es un tipo de inteligencia artificial entrenado con cantidades masivas de texto para entender y generar lenguaje natural. Piensa en él como un sistema que ha “leído” miles de millones de páginas de internet, libros, artículos y documentos, y ha aprendido los patrones del lenguaje humano con una precisión asombrosa.

Cómo funciona un modelo de lenguaje grande

Sin entrar en matemáticas complejas, un LLM funciona prediciendo la siguiente palabra (o más precisamente, el siguiente token) en una secuencia de texto. Si le das la frase “El gato se sentó en el…”, el modelo calcula la probabilidad de cada posible siguiente palabra y elige la más probable: “sofá”, “tejado”, “suelo”, etc.

Esta capacidad aparentemente simple de predecir la siguiente palabra escala de forma sorprendente. Cuando un modelo tiene miles de millones de parámetros (los “pesos” que ajustan las predicciones) y ha sido entrenado con billones de tokens, emerge algo que parece comprensión, razonamiento y creatividad.

La arquitectura que usan la mayoría de LLMs modernos se llama Transformer, inventada por Google en 2017. Los Transformers utilizan un mecanismo llamado atención (attention) que permite al modelo considerar todas las palabras de un texto simultáneamente y entender las relaciones entre ellas, sin importar la distancia. Esta capacidad de “atención” es lo que permite a los LLMs mantener coherencia en textos largos y entender contextos complejos.

De GPT-3 a GPT-4o y Claude: la evolución

La evolución de los LLMs ha sido exponencial:

- 2020 – GPT-3: el modelo que abrió los ojos al mundo sobre las capacidades de los LLMs. 175 mil millones de parámetros

- 2022 – ChatGPT (GPT-3.5): la revolución. Un chatbot accesible para todo el mundo que cambió la industria

- 2023 – GPT-4 y Claude 2: salto cualitativo enorme en razonamiento, precisión y capacidad de seguir instrucciones

- 2024 – GPT-4o, Claude 3.5 Sonnet y Gemini 1.5: modelos más rápidos, baratos y multimodales (texto + imagen + audio)

- 2025 – Claude 4, GPT-4.5, Gemini 2.0: modelos que alcanzan niveles de razonamiento comparables a expertos humanos en muchas tareas

- 2026: consolidación del ecosistema con modelos especializados, más eficientes y más accesibles económicamente

Lo más notable es cómo han bajado los precios: lo que en 2023 costaba dollars por consulta, en 2026 cuesta céntimos. Esto ha democratizado el acceso a la IA avanzada para empresas de cualquier tamaño.

Los principales LLMs en 2026

En 2026, el mercado de LLMs está dominado por cuatro grandes jugadores y un creciente ecosistema open-source. Veamos cada uno en detalle.

GPT-4o y GPT-4.5 (OpenAI)

OpenAI sigue siendo el líder del mercado con sus modelos GPT. En 2026, los modelos más relevantes son:

GPT-4o: el modelo “omni” que procesa texto, imagen, audio y vídeo de forma nativa. Es rápido, económico y extremadamente versátil. Es la opción por defecto para la mayoría de aplicaciones. Precio: desde 2.50$/millón de tokens de entrada.

GPT-4o mini: la versión compacta y ultra-económica. Ideal para tareas que no requieren máxima calidad pero sí velocidad y bajo coste. Precio: desde 0.15$/millón de tokens de entrada. Perfecto para chatbots de alto volumen y clasificación de texto.

GPT-4.5: el modelo de máxima calidad de OpenAI, diseñado para tareas de razonamiento complejo, análisis profundo y generación de contenido de alta calidad. Más caro pero significativamente mejor en tareas que requieren pensamiento paso a paso.

Claude 4 (Anthropic)

Claude 4 de Anthropic se ha consolidado como la alternativa principal a GPT y en muchos benchmarks lo supera. Claude destaca especialmente en:

- Seguimiento de instrucciones: es extraordinariamente bueno para hacer exactamente lo que le pides

- Análisis de documentos largos: con una ventana de contexto de más de 200.000 tokens, puede procesar libros enteros

- Escritura y creatividad: genera texto de alta calidad con un estilo más natural

- Razonamiento y código: excelente para análisis lógico y generación de código

- Seguridad: Anthropic se enfoca especialmente en la IA segura y alineada

La familia Claude en 2026 incluye Claude 4 Opus (máxima calidad), Claude 4 Sonnet (equilibrio calidad-precio, el más popular) y Claude 4 Haiku (rápido y económico). Los precios son competitivos con OpenAI y en muchos casos más baratos.

Gemini 2.0 (Google)

Google ha dado un salto enorme con Gemini 2.0. Este modelo destaca por su capacidad multimodal nativa (texto, imagen, audio, vídeo), su integración con el ecosistema Google (Search, Maps, YouTube) y su ventana de contexto masiva de más de 1 millón de tokens. Esto significa que puede procesar documentos enormes, horas de vídeo o miles de páginas de código de una sola vez.

Gemini 2.0 Flash es particularmente interesante por su velocidad y bajo coste. Google ofrece además un tier gratuito generoso en su API de Gemini, lo que lo convierte en una excelente opción para experimentar y para proyectos con presupuesto limitado.

Llama 3 y modelos open-source (Meta)

Meta ha liderado la revolución open-source en el mundo de los LLMs con su familia Llama. Llama 3 (y sus variantes 405B, 70B, 8B) son modelos de código abierto que cualquiera puede descargar, modificar y ejecutar en sus propios servidores. Esto es revolucionario porque elimina la dependencia de APIs externas y permite control total sobre los datos.

Otros modelos open-source relevantes en 2026 incluyen Mistral (de la empresa francesa Mistral AI), Qwen (de Alibaba), DeepSeek y Phi (de Microsoft). El ecosistema open-source se ha vuelto tan competitivo que los modelos pequeños de 7-13 mil millones de parámetros ya rivalizan con modelos comerciales para muchas tareas.

Modelos locales: Ollama y alternativas

Ollama ha simplificado enormemente la ejecución de LLMs en tu propio ordenador. Con un simple comando puedes descargar y ejecutar modelos como Llama 3, Mistral o Phi localmente, sin enviar datos a ningún servidor externo. Esto es perfecto para:

- Privacidad total: tus datos nunca salen de tu máquina

- Coste cero en API: sin facturas mensuales por tokens

- Experimentación: probar diferentes modelos sin compromiso

- Casos de uso offline: funciona sin conexión a internet

La integración de Ollama con n8n es nativa, lo que significa que puedes crear automatizaciones con IA completamente locales y privadas. En nuestro curso de Agentes IA enseñamos cómo configurar y optimizar modelos locales con Ollama.

Cómo elegir el LLM adecuado para tu caso

Con tantas opciones disponibles, elegir el LLM correcto puede ser abrumador. Aquí tienes los tres factores clave para tomar la decisión correcta.

Precio vs calidad

El precio de los LLMs varía enormemente según el modelo y el volumen de uso. Para darte una referencia con precios de 2026:

- Ultra económico: GPT-4o mini o Gemini Flash (desde 0.10-0.15$/millón de tokens). Perfecto para chatbots de alto volumen, clasificación y tareas simples

- Equilibrio calidad-precio: Claude 4 Sonnet o GPT-4o (desde 2-3$/millón de tokens). Ideal para la mayoría de aplicaciones profesionales

- Máxima calidad: Claude 4 Opus o GPT-4.5 (desde 10-15$/millón de tokens). Para tareas críticas que requieren máxima precisión

- Coste cero: Modelos locales con Ollama. Solo necesitas hardware potente (idealmente una GPU con 16GB+ de VRAM)

La regla general es: empieza con un modelo económico, evalúa los resultados y sube de categoría solo si la calidad no es suficiente. Muchas veces, GPT-4o mini o Claude 4 Haiku son más que suficientes.

Privacidad y datos sensibles

Si trabajas con datos sensibles (información médica, financiera, legal o personal), la privacidad es un factor crítico. Tus opciones de mayor a menor privacidad son:

Modelos locales (Ollama): máxima privacidad, los datos nunca salen de tu servidor. APIs empresariales (OpenAI Enterprise, Claude API): los proveedores garantizan que no usan tus datos para entrenar modelos, pero los datos viajan por internet. Versiones gratuitas (ChatGPT Free, Gemini Free): los datos pueden usarse para mejora del servicio, no recomendable para datos sensibles.

Para la mayoría de empresas, las APIs de OpenAI y Anthropic ofrecen un nivel de privacidad adecuado según sus políticas de datos. Para sectores regulados (sanidad, finanzas), los modelos locales o las versiones enterprise con acuerdos de procesamiento de datos son la opción recomendada.

Velocidad vs precisión

Existe un trade-off natural entre velocidad y precisión en los LLMs. Los modelos más pequeños y rápidos (GPT-4o mini, Claude 4 Haiku, Gemini Flash) responden en milisegundos pero pueden equivocarse en tareas complejas. Los modelos más grandes y precisos (GPT-4.5, Claude 4 Opus) tardan más pero ofrecen respuestas de mayor calidad.

Para chatbots en tiempo real, prioriza velocidad. Para análisis de documentos o generación de contenido, prioriza precisión. Y para lo mejor de ambos mundos, puedes usar una arquitectura de dos capas: un modelo rápido para el primer filtro y un modelo potente para las consultas que lo necesiten.

Cómo usar LLMs en automatizaciones con n8n

Aquí es donde la teoría se convierte en práctica y valor real. Usar un LLM directamente en ChatGPT está bien, pero el verdadero poder emerge cuando lo integras en flujos de trabajo automatizados con n8n.

Conectar OpenAI/Claude con n8n

n8n tiene nodos nativos para conectar con los principales proveedores de LLMs: OpenAI, Anthropic (Claude), Google (Gemini) y Ollama (modelos locales). La configuración es sencilla: introduces tu API key, seleccionas el modelo y configuras los parámetros (temperatura, max tokens, etc.).

Algunos flujos prácticos que puedes crear en minutos:

- Email → LLM → Respuesta automática: recibir un email, analizarlo con IA y generar una respuesta personalizada

- Formulario → LLM → CRM: procesar leads de un formulario, clasificarlos con IA y crear registros en tu CRM

- RSS → LLM → Redes sociales: leer noticias, generar resúmenes y publicarlos automáticamente

- Documento → LLM → Resumen: subir un PDF, extraer el texto y generar un resumen ejecutivo

En nuestro curso de n8n 2026 enseñamos cómo configurar todas estas integraciones paso a paso.

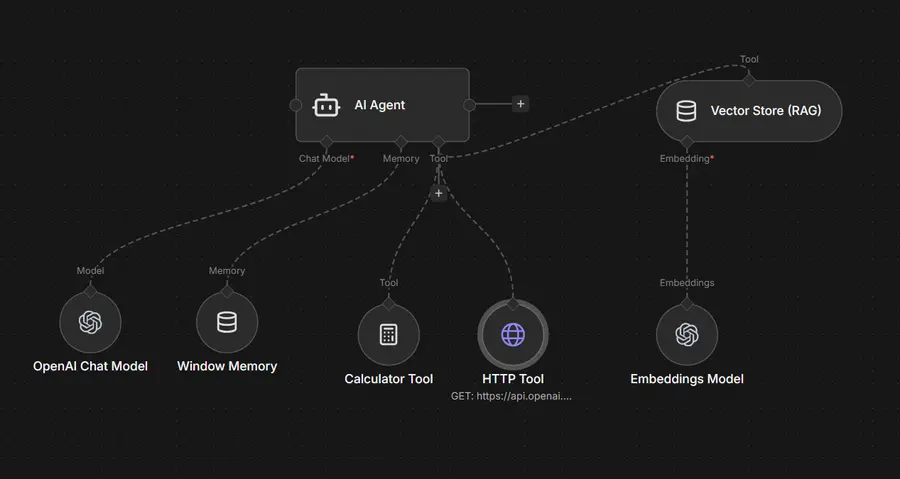

Crear agentes IA con LLMs

Los agentes IA son el siguiente nivel en el uso de LLMs. Un agente no solo responde preguntas: tiene la capacidad de usar herramientas, tomar decisiones y ejecutar acciones de forma autónoma. En n8n, puedes crear agentes que:

- Buscan información en bases de datos o internet antes de responder

- Ejecutan acciones como enviar emails, crear registros o llamar APIs

- Recuerdan conversaciones anteriores gracias a la memoria

- Consultan documentos específicos mediante RAG

- Delegan tareas a otros agentes especializados

Los agentes IA son la tendencia más importante de 2026 en automatización. Si quieres estar a la vanguardia, nuestro curso de Agentes IA es la formación más completa en español sobre este tema.

Procesamiento de documentos con IA

Una de las aplicaciones más prácticas de los LLMs con n8n es el procesamiento automatizado de documentos. Puedes crear flujos que extraigan texto de PDFs, facturas, contratos o emails, y usar un LLM para clasificar, resumir, extraer datos estructurados o detectar anomalías. Por ejemplo, un flujo que recibe facturas por email, extrae los datos (proveedor, importe, fecha, concepto) con GPT-4o y los registra automáticamente en tu software de contabilidad. Esto es automatización inteligente de verdad.

LLMs para empresas: aplicaciones prácticas

Los LLMs están transformando la forma en que las empresas operan. Estas son las tres aplicaciones más impactantes en 2026.

Atención al cliente automatizada

Los chatbots con LLM han revolucionado la atención al cliente. A diferencia de los chatbots antiguos basados en reglas, un chatbot con GPT-4o o Claude puede entender preguntas formuladas de cualquier manera, responder de forma natural y resolver problemas complejos. Combinado con RAG para acceder a tu documentación, puedes automatizar el 70-80% de las consultas de soporte.

El ROI es impresionante: una empresa mediana puede ahorrar miles de euros al mes en personal de soporte mientras mejora los tiempos de respuesta (de horas a segundos) y la disponibilidad (24/7, 365 días).

Generación de contenido

Los LLMs se han convertido en herramientas esenciales para la generación de contenido: artículos de blog, descripciones de productos, emails de marketing, publicaciones en redes sociales, guiones de vídeo y más. No sustituyen al escritor humano, pero multiplican su productividad por 5x o 10x.

Con n8n, puedes automatizar todo el pipeline de contenido: investigar temas con IA, generar borradores, optimizar para SEO, crear variantes para redes y publicar automáticamente. Es el sueño de cualquier equipo de marketing.

Análisis de datos y reporting

Los LLMs pueden analizar datos, detectar patrones, generar insights y crear reportes en lenguaje natural. Ya no necesitas un analista de datos para entender qué dicen tus números: puedes crear un flujo en n8n que extraiga datos de tu CRM, Google Analytics o base de datos, los envíe a un LLM y reciba un informe ejecutivo con los puntos clave, tendencias y recomendaciones de acción.

Este es el tipo de automatización que genera un impacto inmediato y medible en cualquier negocio. Y con las herramientas adecuadas, puede estar funcionando en unas pocas horas.

Si quieres implementar alguna de estas soluciones en tu empresa y necesitas ayuda personalizada, puedes reservar una consultoría de 1 hora con nuestro equipo. Te ayudamos a diseñar la solución perfecta para tu caso.

El futuro de los LLMs: tendencias 2026-2027

El campo de los LLMs evoluciona a una velocidad vertiginosa. Estas son las tendencias más importantes que estamos viendo para 2026-2027:

- Modelos más pequeños y eficientes: la tendencia es hacia modelos que ofrecen gran calidad con menos recursos. Los modelos de 7-13B parámetros ya rivalizan con GPT-3.5 y permiten ejecución local en hardware consumer

- Agentes IA autónomos: LLMs que no solo responden sino que planifican, ejecutan y aprenden de forma autónoma. Los frameworks de agentes como los de n8n están liderando esta tendencia

- Multimodalidad completa: modelos que entienden y generan texto, imagen, audio y vídeo de forma nativa e integrada

- Especialización por verticales: modelos fine-tuneados para sectores específicos (médico, legal, financiero) con conocimiento experto

- IA on-device: modelos que se ejecutan directamente en smartphones y dispositivos edge sin necesidad de conexión a internet

Lo que está claro es que los LLMs no son una moda pasajera: son una revolución tecnológica comparable a internet. Quien entienda y domine estas herramientas tendrá una ventaja competitiva enorme en los próximos años.

Aprende a usar LLMs con n8n en VA360 Academy

En VA360 Academy estamos comprometidos con enseñar las tecnologías que están transformando el mundo. Los LLMs son la pieza central de esta transformación, y saber usarlos correctamente es una habilidad que el mercado demanda cada vez más.

Nuestros cursos te enseñan no solo la teoría, sino cómo aplicar los LLMs en proyectos reales con n8n como herramienta de integración. Esto es lo que encontrarás:

- Curso de n8n 2026: aprende a conectar LLMs con automatizaciones prácticas

- Curso de Agentes IA: domina los agentes IA, RAG, memory y tools con LLMs

- Curso de Make.com: integra IA en tus escenarios de Make.com

- Curso de VibeCoding: usa LLMs para programar aplicaciones sin experiencia previa

- Máster en Automatizaciones y Agentes IA: todo incluido por 297€ con acceso de por vida

Todos los cursos están creados por Valentín Ayesa, embajador oficial de n8n en España, con más de 2.000 alumnos formados. Se actualizan constantemente para incluir los últimos modelos y técnicas. Empieza gratis con nuestra masterclass gratuita o únete a la comunidad gratuita para mantenerte al día.

Preguntas frecuentes

Cuánto cuesta usar un LLM?

El coste de usar un LLM varía enormemente según el modelo y el volumen. Los modelos más económicos como GPT-4o mini cuestan desde 0.15$/millón de tokens de entrada, lo que se traduce en céntimos por consulta. Para una empresa que procesa 1.000 consultas al día con un modelo económico, el coste puede ser de 5-20€ al mes. Los modelos premium como GPT-4.5 o Claude 4 Opus son más caros pero ofrecen mayor calidad. Y si usas modelos locales con Ollama, el coste de API es cero (solo pagas el hardware o servidor). La tendencia general es que los precios bajan constantemente: lo que hoy cuesta 1€, en 6 meses probablemente costará 0.50€.

Puedo usar un LLM gratis?

Sí, hay varias formas de usar LLMs de forma gratuita. La más directa es usar ChatGPT Free, Claude Free o Gemini Free a través de sus interfaces web, aunque tienen límites de uso. Para uso programático (APIs), Google Gemini ofrece un tier gratuito generoso en su API. Además, puedes ejecutar modelos open-source como Llama 3 o Mistral localmente con Ollama, lo cual es completamente gratis (solo necesitas un ordenador con suficiente RAM y preferiblemente una GPU). Para uso profesional, las opciones gratuitas suelen quedarse cortas en límites y velocidad, pero son perfectas para aprender y experimentar.

Los LLMs van a sustituir a los programadores?

No, los LLMs no van a sustituir a los programadores, pero sí van a transformar radicalmente su trabajo. En 2026, los desarrolladores que usan IA como copiloto (mediante herramientas de VibeCoding como Cursor o GitHub Copilot) son entre 3 y 10 veces más productivos que los que no. Lo que sí está cambiando es el perfil necesario: ya no basta con saber escribir código; ahora importa saber diseñar sistemas, gestionar prompts, integrar servicios y resolver problemas complejos. Los programadores que adopten la IA serán más valiosos que nunca; los que la ignoren, perderán relevancia. Es un momento de adaptación, no de extinción. En VA360 Academy enseñamos este enfoque híbrido con nuestro curso de VibeCoding.

Qué es mejor, GPT-4 o Claude?

La respuesta honesta es que depende de la tarea. En 2026, GPT-4o y Claude 4 Sonnet están muy igualados en la mayoría de benchmarks. Claude tiende a ser mejor en escritura creativa, análisis de documentos largos y seguimiento preciso de instrucciones complejas. GPT-4o suele ser mejor en tareas multimodales (imagen + texto), tiene un ecosistema más amplio de plugins y herramientas, y su API es ligeramente más rápida. En la práctica, muchos profesionales (incluidos nuestros alumnos) usan ambos modelos según la tarea: Claude para escribir y analizar, GPT para multimodal y código. Con n8n puedes crear flujos que usen diferentes modelos para diferentes pasos, aprovechando lo mejor de cada uno.

Los LLMs son, sin duda, la tecnología más transformadora de nuestra generación. En pocos años hemos pasado de modelos que apenas podían completar frases a sistemas que razonan, crean, analizan y asisten de formas que parecían ciencia ficción. Entender esta tecnología y saber aplicarla es una ventaja competitiva que no puedes ignorar. Ya sea para automatizar tu negocio, crear productos con IA o simplemente ser más productivo, los LLMs están aquí para quedarse y solo van a mejorar. El momento de aprender es ahora, y en VA360 Academy estamos listos para guiarte en el camino.

Respuestas